Aplicações que exigem resposta em tempo real, como automação industrial, monitoramento de operações críticas, cidades inteligentes e sistemas de mobilidade avançada, têm pressionado os limites da arquitetura tradicional de nuvem e impulsionado a adoção de modelos distribuídos. Nesse cenário, cresce a necessidade de complementar a centralização dos hyperscalers com infraestrutura mais próxima dos pontos de coleta e processamento de dados, dando tração ao edge computing como extensão natural da nuvem.

Segundo o diretor de inovação e produtos B2B da Claro empresas, Rodrigo Assad, essa mudança responde diretamente às necessidades de performance e às premissas de aplicações como automação industrial, cidades inteligentes, operação de veículos autônomos dentre outros. Durante o Mobile World Congress (MWC) deste ano, a companhia anunciou uma oferta baseada em parceria com a AWS que endereça essa tendência. A nova oferta é um desdobramento dessa parceria, na qual a empresa vem desenvolvendo equipes com certificações e experiência nos padrões da AWS. “Na prática, teremos uma extensão da AWS operando dentro da rede da Claro. Com isso, conseguimos reduzir a latência em cerca de 50% e aproximar muito mais as aplicações do cliente final”, explica Assad.

Infraestrutura distribuída ao estilo da nuvem

Existem dois grandes desafios que viabilizam esta oferta, um deles é a redução de custos mantendo a mesma qualidade das ofertas da AWS e o outros esta nas aplicações em que o dado precisa ser interpretado em tempo real e muitas vezes deve disparar uma ação imediata, não faz sentido trafegar essas informações por redes de telecomunicações até os grandes datacenters na nuvem pública.

Em casos como monitoramento de máquinas industriais, sistemas de transporte ou controle de segurança, cada milissegundo no tempo de resposta faz toda a diferença. Enquanto a latência no acesso à nuvem pública pode chegar a 80 ms, com infraestrutura mais próxima, esse tempo cai pelo menos 50%, chegando a uma redução de até 75%.

Esse ganho, irrelevante em aplicações comuns, torna-se crítico em operações físicas. Em sistemas de transporte, por exemplo, pode significar o avanço de metros ou centímetros no deslocamento de um veículo, conforme o tempo entre a leitura de um dado e a execução de um comando de frenagem.

“A grande oportunidade surge quando o data center passa a estar dentro da própria operadora, já integrado à sua rede. Nesse cenário, conseguimos oferecer as mesmas capacidades e serviços dos hyperscalers, porém com uma estrutura de custos significativamente menor, menor latência e maior controle operacional ”, menciona Assad. “Mas não se limitam a isso. Estamos falando de processamento de dados muito próximo de onde eles são gerados”, esclarece.

Esta oferta além da economia dos custos de cloud viabiliza de forma concreta a adoção de edge computing avança principalmente em ambientes industriais e operacionais, com aplicações como análise de vídeo em tempo real para monitoramento de máquinas, controle de condições de segurança em ambientes insalubres e automação de processos críticos. “Em muitas situações, se uma máquina operar por poucos segundos fora dos parâmetros ideais, isso pode gerar falhas operacionais ou até colocar pessoas em risco. Ter uma análise imediata desses dados faz toda a diferença”, exemplifica.

Nesse contexto, entram soluções como o AWS Outposts, uma modalidade em que racks ou servidores da própria AWS são instalados próximos à operação, seja dentro do ambiente do cliente ou em infraestruturas regionais. Esses equipamentos são entregues como uma extensão da nuvem pública, com os mesmos serviços, APIs, ferramentas de gestão e modelo de consumo, mas operando localmente para reduzir latência e atender requisitos de processamento em tempo real.

Capilaridade, conectividade e arquitetura resiliente

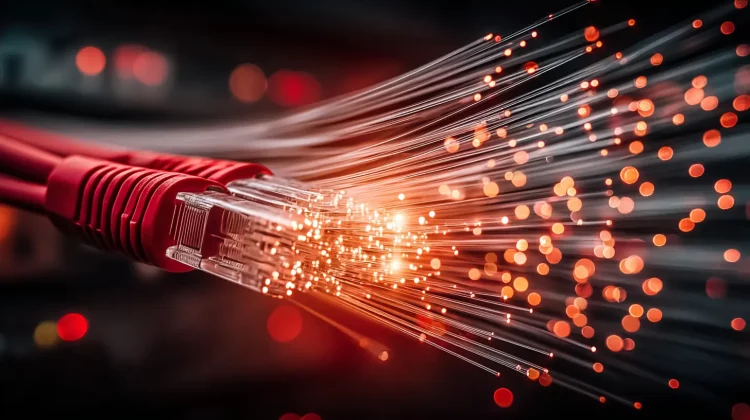

A viabilização do edge depende diretamente da evolução das redes e da capacidade de distribuir infraestrutura com consistência operacional. Redes privativas 5G oferecem um ambiente mais controlado, com garantia de qualidade de serviço e baixa latência, além da possibilidade de criação de fatias dedicadas para aplicações críticas. A fibra óptica complementa essa base com alta capacidade e confiabilidade.

“Paralelamente, continuamos contando com os mecanismos tradicionais de conectividade, como redes de fibra óptica de alta capacidade, que também permitem conectar os clientes aos ambientes de processamento com altos níveis de desempenho, confiabilidade e qualidade de serviço”, informa Assad.

Nesse modelo, é estratégico para provedores globais disponibilizar partes de sua infraestrutura nas localidades onde ocorrem as operações. O desafio está em garantir capilaridade com parceiros capazes de manter instalações críticas e equipes qualificadas em todo o território.

Esse foi um fator determinante na parceria entre AWS e Claro. A operadora reúne cobertura nacional, competências em telecomunicações, data centers e conhecimento das verticais da indústria. Além disso, toda a gestão de SLAs, operação e controle financeiro pode ser consolidada em um único console, preservando a experiência da nuvem pública mesmo em ambientes distribuídos.

A arquitetura também incorpora mecanismos de resiliência. “Uma abordagem comum é distribuir as workloads entre edge e datacenters regionais, mantendo réplicas das aplicações em ambientes próximos. Dessa forma, se por algum motivo um ambiente de edge tiver uma falha, um datacenter próximo pode assumir temporariamente a operação”, explica Assad.

Eficiência operacional, segurança e modelo de consumo

A descentralização do processamento traz impactos diretos em segurança e custos. Ao processar dados localmente, reduz-se o volume de informação trafegado na rede, o que diminui a exposição e otimiza o uso da infraestrutura. A rede passa a transportar apenas dados já processados para ambientes centrais.

Esse desenho também reduz o escopo de proteção ao perímetro, facilitando a gestão de segurança contra perda de dados, invasões e vazamentos. Há ainda ganhos em continuidade operacional, com esquemas de contingência estruturados pela operadora para manter aplicações críticas em funcionamento.

Do ponto de vista comercial, a proposta mantém a lógica da nuvem pública. “A proposta é garantir ao cliente a mesma experiência de contratação e uso que ele já tem em uma nuvem pública tradicional, porém com um diferencial importante, que é a baixa latência e maior proximidade com a infraestrutura da rede, com uma redução que pode chegar a 30% dos custos”, diz Assad.

A oferta inclui ainda serviços profissionais para apoiar o desenho, implementação e operação das aplicações, ampliando o papel do provedor na jornada digital dos clientes.

Nesse cenário, o edge computing consolida-se como uma extensão natural da nuvem, combinando processamento distribuído, conectividade avançada e modelos flexíveis de consumo para atender às exigências das aplicações emergentes.